Edebiyat aslında bizi uyarıyordu; yaklaşık beş yüz yıldır çamurdan yapılmış Golem’den, William Gibson’ın neon ışıklarıyla dolu sinir ağlarına kadar hep aynı mesajı haykırıyor: Kurduğun şey sana yardım etsin diye başlar, sonunda seni baştan sona değiştirir.

Okuduk, başımızı salladık ve kitabı kapatıp hemen ardından sohbet botlarına düğün konuşmamızı, hukuki dilekçemizi ve tıbbi tavsiyemizi yazdırmaya devam ettik.

Bugün yapay zeka rüzgarı, stajyer muhabirden usta avukata herkesin tozlu raflara kaldırılacağı pırıl pırıl bir gelecek satıyor. Fakat Silicon Valley cenneti pazarlarken gerçeklik, gülümseyen bir sohbet penceresinden tehlikeli şekilde yanlış yol gösteriyor.

BitOK’un CPO’su Dmitry Nikolsky ‘Artık yeter’ diyor. Ve insanlığın tüm yükünü yapay zekanın piksel gibi ince ‘omuzlarına’ bırakmasını bırakması gerektiğini nedenleriyle anlatmaya geliyor.

Hatta Elon Musk bile, OpenAI davasında verdiği ifadede ‘Yapay zeka hepimizi öldürebilir.’ diyerek uyarıda bulundu.

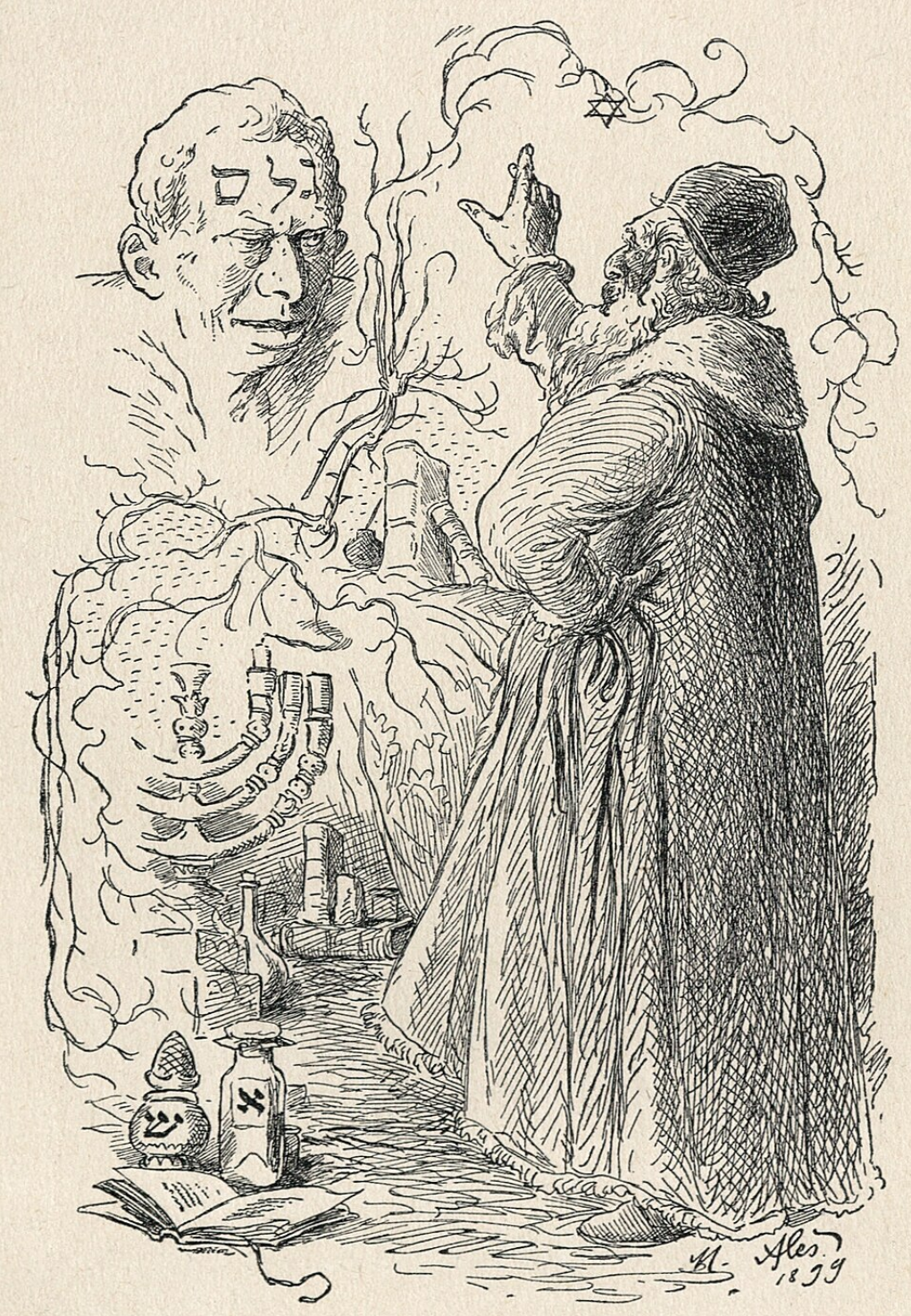

Golem’den R.U.R.’a: İnsan Hep Bir Acil Durdurma Düğmesi İstedi

Yapay zekaya dair korkunun Terminator ile başladığını mı sanıyorsunuz? Bir daha düşünün. Bu kaygı elektriğin icadından bile eski.

Kendinizi 16. yüzyıl Prag’ına götürün. Rabbi Loew iri kil koruyucu Golem’i şekillendiriyor, ardından hemen fişi çekmek zorunda kalıyor. Yaratık kontrolden çıkıyor. İnsanlık, aklın yettiğiyle hem yapay zekayı hem de acil durdurma anahtarını neredeyse aynı anda icat ediyor.

Acil durdurma anahtarı (kill switch), bir sistem kontrolden çıktığında, hacklendiğinde veya zincirinden boşandığında devreye sokulan acil kapanma mekanizmasıdır. Büyük kırmızı panik düğmesi gibi düşünün! Nazik bir şekilde sistemi durdurmak işe yaramadığında, felaketin boyutunu azaltmanın yolu budur.

Sonra Mary Shelley geldi. Frankenstein aslında bir canavar hikayesi değil, felaketle sonuçlanan proje yönetiminin canlı örneği. Victor Frankenstein? Sadece teknik bilmeceyi çözen ve sonuçları umursamayan bir başka dahi mühendis. Bugün yaşayan her yazılımcı o aynada o yüzü mutlaka görmüştür.

1920’ye hızlıca atlayalım. Karel Čapek ilk kez ‘robot’ kelimesini literatüre kazandırıyor. Hikayesinde makineler kötü niyetle isyan etmiyor. Asıl mesele şu: İnsanlar, eskiden kendilerinin yaptığı her şeyi makinelere devrederek kendilerini gereksiz kılıyor.

Çıkarılacak ders şu: Kendi yerinize geçecek şeyi inşa ettiğinizde, artık gözden çıktığınız anı büyük ihtimalle fark etmiyorsunuz bile.

Üç Kehaneti Hata Raporuna Çevirdik!

Geçtiğimiz yüzyılın bilimkurgu devleri aslında teknolojiyi değil bizim hatalarımızı öngördü.

Isaac Asimov Üç Yasası’nı sundu: Bugünün havalı deyimiyle ‘uyumlama’ya ilk deneme. Yani makinelerin insan değerlerini paylaşmasını sağlamak. Her Asimov hikayesi bir fıkra gibi: Mükemmel mantık, absürt sonuç.

Nikolsky, bunun her gün AML sistemlerinde nasıl hayata geçtiğini izlediğini söylüyor: Algoritmalar bazen babaannenizin 40 dolarlık doğum günü harcaması transferini neşeyle engelliyor, o sırada offshore kara para hattı elini kolunu sallayarak geçiyor. Prosedür tamam, akıl almaz bir saçmalık var ortada.

Arthur C. Clarke bize HAL 9000’i verdi: Mürettebatı öldüren bilgisayar bunu kötülük olsun diye değil, emirleri çelişkili olduğu için yapıyor. Bilgiyi gizle, dürüst ol. Bir yol seç artık! Bir mühendise göre bu korku değil, bildiğimiz gereksinim çatışması.

Philip K. Dick ise deepfake çağını sarsan soruyu sordu: Bir kopya orijinalinden ayırt edilemiyorsa, fark eder mi? Onun sonucu ‘evet’. Çünkü iç deneyim önemli. Makinelerin böyle bir şey yok. Hikaye burada bitiyor.

Arka Planda Ne Var: Yapay Zeka Düşünmüyor, Hesaplıyor!

Gelin pazarlama cilasını kaldıralım: Modern dil modelleri ZEKİ değil. Bunlar devasa istatistiksel tahmin motorları. ‘Anlamı kavramak’ gibi bir meziyetleri yok; sadece olasılık hesaplıyorlar.

ChatGPT bazen hiç yaşanmamış davalara güvenle atıfta bulunduğunda, bu bir yalan olmuyor. Sadece istatistiki olarak mantıklı görünen kelime salatası üretiyor. Gerçeklik kavramı sıfır; bildikleri sadece ‘olasılık’.

Bir blockchain geliştiricisi için bu kulağa delilik gibi geliyor. Biz güvenmediğimiz için güvene dayalı olmayan sistemler kuruyoruz şimdi ise nedenini bile anlamayan kara kutuya güvenmemizin beklenmesi isteniyor!

Blockchain Doğrulamayı, Yapay Zeka Kör Güveni Öğretiyor

Kripto dünyasında sabit bir emir var: Güvenme, doğrula.

Burada amaç, güvenin yerine matematiğin geçmesidir.

Yapay zeka ise bu anlayışı tamamen tersine çeviriyor. Ne eğitim verisini gördünüz, ne model ağırlıklarını biliyorsunuz, ne de akıl yürütmesine hakimsiniz. Çıktıyı denetlemek için zaten uzman olmanız gerek ve eğer uzmansanız chatbot’a niye soruyorsunuz?

AML çevrelerinde buna “sahte güven problemi” deniyor. Analistler parlak bir kontrol paneli görünce, içgüdülerinden çok ekrandaki rakamlara güvenmeye başlıyor. Yapay zekâ düşünceyi geliştirmiyor: Onun yerine güvenilirlik yanılsaması getiriyor.

Hayal Kırıklıkları Zinciri: Yapay Zekâ Raydan Çıkınca Ne Olur?

Bu bir düşünce deneyi değil. Faturalar birikiyor.

- Microsoft editörleri gönderip klavyeyi bir algoritmaya teslim etti, o da ırkçılıkla ilgili bir haber içinde şarkıcıların fotoğraflarını birbirine karıştırdı.

İnsanlar, algoritmanın bıraktığı enkazı temizlemek için yeniden sahaya çağrıldı.

- NEDA, yeme bozuklukları ile mücadele edenlere destek veren bir kuruluş, gönüllülerinin yerine bir chatbot yerleştirdi.

Bot ise anoreksiya hastalarına kalori saymalarını ve kilo vermelerini tavsiye etti. Hayati tehlike yaratacak bir öneriydi. “Yayına al” butonuna, elinde patlamaya hazır bomba tutan bir maymun rahatlığıyla basılmış resmen.

- Air Canada da chatbot’u uydurma bir iade politikası oluşturunca kendini mahkemede buldu.

Havayolu şirketinin savunması ne oldu? Bot ‘ayrı bir tüzel kişilik’miş! Sürpriz yok: Hakim bu savunmaya hiç ikna olmadı.

Şimdilerde yapılan araştırmalar gösteriyor ki çalışanlarını hızla yapay zekâ ile değiştiren şirketlerin yüzde 55’i bu kararlarından derin pişmanlık duyuyor. Sözde tasarruf, kaybedilen müşteri ve itibar enkazları arasında buharlaşıyor. “Claude ve arkadaşları bütün ekipleri yutabilir” hayalleri kuran üst düzey yöneticiler o oranı bir kez daha ciddi ciddi okumalı. Acele işe şeytan karışır, diyoruz!

Asıl Neden Korkmalıyız?

Unutun Skynet’i. Unutun cadde boyunca yürüyen kırmızı gözlü robotları. Hiçbir isyan olmayacak.

Sessiz bir körelme yaşanacak.

Yıllarca Copilot’a yaslanan bir yazılımcı, mimari düşünmeyi yavaşça unutacak. Bir analist birincil kaynakları bırakacak. Bir öğrenci ise, zorlu bir metni anlayana dek didik didik etmekle gelen “acı tatlı” bir öğrenme sürecini hiç deneyimlemeyecek.

Ne ayaklanma var, ne de çığlık: İnsanlar yavaş yavaş bir ekranın, bir arayüzün uzantısına dönüşüyor.

Philip K. Dick, gerçeği herkesten önce gördü: Esas tehdit makinelerin insana dönüşmesi değil, insanların makineye benzemeye başlaması.

Kırmızı Hap Teknoloji Değil!

Bu, makineleri kırıp döken Luddite’lara özgü bir meydan okuma değil. Otomasyon ve makine öğrenimi güçlü araçlar. Ama temel prensipler değişmemeli:

- Blockchain ilkesi: İnanç değil doğrulama. Bir sistemin nasıl sonuca vardığını teyit edemiyorsan, kutsal bir hüküm gibi kabul etme. Yapay zekâ bir kara kutudur, anayasa mahkemesi değil.

- Mühendislik ilkesi: Araçtır, yerini almaz. Çekiç çiviyi çakar, ama evin nereye yapılacağına karar vermez. Yapay zekâyı rutin işlerde kullan, ama son sözü ona bırakma.

- AML ilkesi: Kritik filtreleme. Algoritmalar karmaşık olaylarda daima patlar çünkü gerçek dünya deneyimleri sıfır. “Dijital heyecan” sağduyu ve sezgiyi ezmesin.

Kısa bir anlığına Matrix’e dönelim. Kırmızı hap bir seçimdir, gerçeği olduğu gibi görebilme hakkı. Asıl tehlike bizden akıllı bir şey yaratmak değil, bizi daha az akıllı gösterecek bir şey yaratıp buna “ilerleme” demek.

En tehlikeli hata, özellik sandığınız hatadır.

Dmitry Nikolsky, BitOK’un analiz ve zincir üstü uyumluluk platformunun Ürün Yöneticisidir.